Nowe Serwisy z AWS re:Invent 2016 po Ludzku (i jak to się ma do Azure i Google Cloud) – Część II

W ostatnim odcinku opowiedzieliśmy sobie o Amazon Athena, AWS Glue i AWS Step Functions.

Czas na kolejny odcinek, gdzie spojrzymy na nowości z konferencji AWS re:Invent, jak ma się dana nowość do oferty Mirosoft Azure i Google Cloud Platform oraz spojrzymy w przyszłość.

Zaczynamy.

Amazon LEX

Serwis, który pozwala budować nową formę interfejsu z systemami. Do tej pory podawało się komunikaty lub klikało guziczki. Teraz można wykorzystać LEX (od aLEXa) do zbudowania interefejsów, z którymi można… porozmawiać (tekstowo lub głosowo). Amazon LEX posiada automatic speech recognition (ASR) oraz natural language understanding (NLU). Te dwie funkcję umożliwiają budowanie rozwiązań, które rozumieją kontekst.

https://twitter.com/basche42/status/809295805739765760

Microsoft Azure:

Microsoft Azure już od jakiegoś czasu działa dużo w tej niszy. Po pierwsze ogłosił Azure Cognitive Services, które zawierają wiele usług Artificial Intelligenec as a Service (AIaaS) używanych do budowych botów, np. Language Understanding Intelligent Service. Microsoft wypuścił też Bot Framework, który ułatwia budowanie botów. Kilka tygodni temu ogłosił Azure Bot Service, który spina powyższe z innymi usługami Azure (np. Azure Functions). Pojawiają się też nowe aplikacje budowane w oparciu o Azure Bot Service, które bardzo ułatwiają budowanie niektórych aplikacji – np. QnA Maker.

Google Cloud Platform:

Google Cloud nie ma gotowych serwisów umożliwiających budowanie botów i interfejsów głosowych. Posiada jednak dobrze rozwinięty zestaw usług AIaaS – Cloud Natural Language API i Cloud Speach API.

Przyszłość:

Chyba nie trzeba nikogo przekonywać, że komunikacja z systemami za pomocą głosu to nieunikniona forma ewolucji. Dążymy oczywiście do interfejsu mózg – maszyna, jednak zanim to nastąpi systemy głosowe mocno zmienią pracę z maszynami jakie znamy. Amazon Echo, który wykorzystuje Amazon Alexa ma bardzo dobrą opinię wśród użytkowników. Teraz ten serwis dostępny jest dla każdego… za kilkanaście dolarów per tysiące komunikatów.

Amazon Polly

Ten serwis umożliwia zamianę tekstu na słowa, w 24 językach… w tym po polsku. Serwis bazuje używa technologii deep learning, aby z każdą wypowiedzią zwiększać jakość tworzonych wypowiedzi. Serwis jest bardzo prosty. Z jednej strony wrzucasz tekst, z drugiej strony słyszysz głos.

Microsoft Azure:

Microsoft posiada Bing Speach API. Działa w obie strony. Posiada opcję zmiany mowy na tekst i tekstu na mowę. Niestety nie wspiera jeszcze języka polskiego.

Google Cloud Platform:

Google posiada Cloud Speech API. W tej chwili działa w kierunku zamiany mowy na tekst. Wspiera natomiast 80 języków.

Przyszłość:

Interfejsy głosowe przyjmą się, gdy (po pierwsze) jakość wypowiadanych zdań przez maszyny będzie identyczna do standardowej mowy człowieka oraz (po drugie) gdy zrozumienie mowy człowieka (nawet sepleniącej jak moja) będzie odbywała się z blisko 100% poprawności. Popularyzacja AIaaS dookoła zamiany mowy na tekst i teksty na mowe jest bardzo dobrym i naturalnym krokiem.

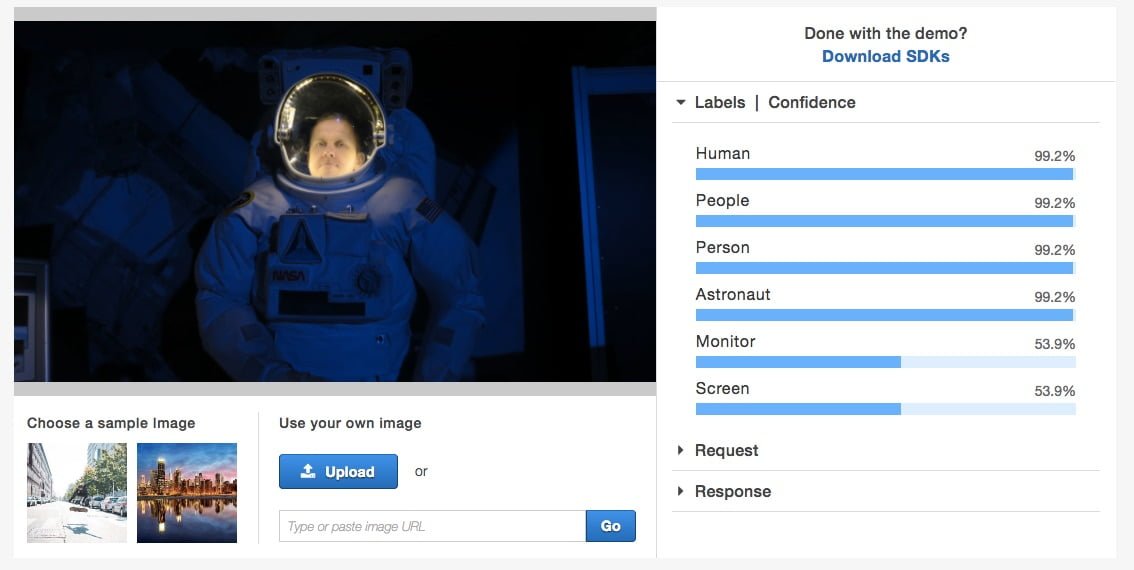

Amazon Rekognition

Usługa od Amazon Web Services, która rozpoznaje co jest na zdjęciach i wykonuje pewne akcje. W tej chwili do wyboru mamy: porównanie twarzy, rozpoznać twarze, rozpoznać co jest na zdjęciu, szukać po twarzy (lista wszystkich zapytań). Usługa rozpoznaje wiele elementów, np. otwarte usta i dziesiątki innych elementów.

Microsoft Azure:

Microsoft Azure posiada bardzo podobną usługę, o której pisłem w artykule Sztuczna Inteligencja 101. Mowa tu oczywiście o Face API, Emotion API and Computer Vision API.

Google Cloud Platform:

Google posiada Cloud Vision API, które rozpoznaje z niesamowitą jakości dużo więcej elementów niż Amazon Rekognition (np. ukryty tekst na obazie). Oczywiście jest to związane z latami optymalizacji rozpoznawania obrazów używanego w Google Search.

Przyszłość:

Usługi rozpoznawania obrazów dostępne dla programistów to ektremalnie kusząca opcja. Do tej pory firmy (również w Polsce) budowały własne sieci neuronowe specjalizujące się w rozpoznawaniu obrazów i uczyły je mannualnie pewnych wzorców. W tej chwili można skorzystać z wielu lat pracy największych gigantów za $1 ($1 za 1000 obrazków w Amazon Rekognition).

Amazon EC2 Elastic GPUs

Procesory graficzne przeżywają lata sławy dzięki wykorzystaniu ich w machine learning, deep learning, zaawansowanych analizach, w genomice. Ciągle też jest zapotrzebowanie na wirtualne maszyny z procesorami graficznymi do gier, wizualizacji, modelowania 3D.

AWS wprowadził kilka miesięcy temu instancje P2, które mają wbudowane procesory graficzne NVIDIA K80.

W tej chwili daje tez możliwość podłączania procesorów graficznych do dowolnych instancji, bez skupiania się wyłącznie na instancjach P2. Instancje P2 będą dalej wykorzystywane np. przez takie firmy jak Algorithmia do budowania rozwiązań opartych o deep learning. Będzie natomiast łatwiej dodawać i odejmować mocy procesorów graficznych do mniej zaawansowanych rozwiań. W pierwszej wersji będzie dostęp do 4 modeli: od eg1.medium (1 GB GPU memory) do eg1.2xlarge (8 GB GPU memory).

Microsoft Azure:

Microsoft posiada instancje N, które mają być dostępne dla wszystkich w grudniu 2016. Nie posiada jeszcze opcji dołączania procesorów graficznych na żądanie do dowolnych maszyn.

Google Cloud Platform:

Google ogłosił dostęp do maszyn z procesorami graficznymi na początek roku 2017. Nie posiada jeszcze opcji dołączania procesorów graficznych na żądanie do dowolnych maszyn.

Przyszłość:

Model AWS jest bardzo przyjazny użytwkonikowi, gdzie możliwe będzie dodanie takiej mocy procesorów graficznych jak potrzeba. Zobaczymy jak to będzie wyglądało w rzeczywistości.

Co Dalej?

W następnych odcinkach skupimy się na:

- Nowe typy instancji EC2 – w tym F1, wyposażone w układy FPGA.

- Amazon Lightsail – usługę serwerów wirtualnych VPS.

- AWS Batch – batch computing w wykonaniu AWS.

- Amazon EC2 Systems Manager – automatyzacja zadań w systemach operacyjnych.

- AWS Lambda@Edge – wykonywanie funkcji lambda na pakietach na poziomie CDN.

- Blox – Zarządzanie kontenerami i orkiestracja – wydana jako OpenSource.

- Amazon Aurora dla PostgreSQL – silnik PostgreSQL na platformie bazodanowej AWS.

- AWS CodeBuild – usługa budująca paczki kodu i testuje zbudowane paczki.

- AWS Greengrass – uruchamianie funkcji AWS Lambda na urządzeniach IoT.

- AWS Snowball Edge – 100TB skrzyneczka z computingiem, do przesyłania danych.

- AWS Snowmobile – 100PB skrzyneczka… na kółkach do przesyłania danych.

- VMware on AWS Cloud – uruchomienie maszynki w środowisku VMware na AWS.

- Amazon Pinpoint – notyfikacje dla urządzeń mobilnych z opcjami marketingowymi.

- Amazon Shield – Ochrona przed DDoS

Podsumowanie

Chcesz spędzić ze mną cały dzień rozmawiając o chmurze i dowiedzieć się wszystkiego, czego nauczyłem się przez ostatnie 4 lata?

Razem z IDC organizuję warsztaty – Wszystko co powinieneś wiedzieć o CHMURZE PUBLICZNEJ, ale boisz się zapytać… dostawcy.

Będzie dużo praktyki, dużo wiedzy i masa historii z życia wziętych. Warsztaty odbędą się 19 stycznia 2017. Zostały 2 miejsca. Kolejny termin dopiero pod koniec lutego 2017. Gorąco zapraszam. W tym wydaniu skupimy się na Amazon Web Services, Microsoft Azure i Google Cloud Platform.

Już 21 czerwca dowiesz się, jak możesz wykorzystać AI w Twojej firmie. Damian Mazurek i Piotr Kalinowski wprowadzą Cię w świat sztucznej inteligencji i LLM.

Przed nami nowy rozdział! Chmurowisko dokonało połączenia z polskim Software Mind – firmą, która od 20 lat tworzy rozwiązania przyczyniające się do sukcesu organizacji z całego świata…

Grupa Dynamic Precision podjęła decyzję o unowocześnieniu swojej infrastruktury. Razem z Oracle Polska prowadzimy migrację aplikacji firmy do chmury OCI.

Już 21 czerwca dowiesz się, jak możesz wykorzystać AI w Twojej firmie. Damian Mazurek i Piotr Kalinowski wprowadzą Cię w świat sztucznej inteligencji i LLM.

Zapisz się do naszego newslettera i

bądź z chmurami na bieżąco!

z chmur Azure, AWS i GCP, z krótkimi opisami i linkami.